深度递归残差网络

Abstract

52 con-volutional layers.递归网络会增加深度同时不增加参数的数量。

1 INSTRUCTION

主要就是小

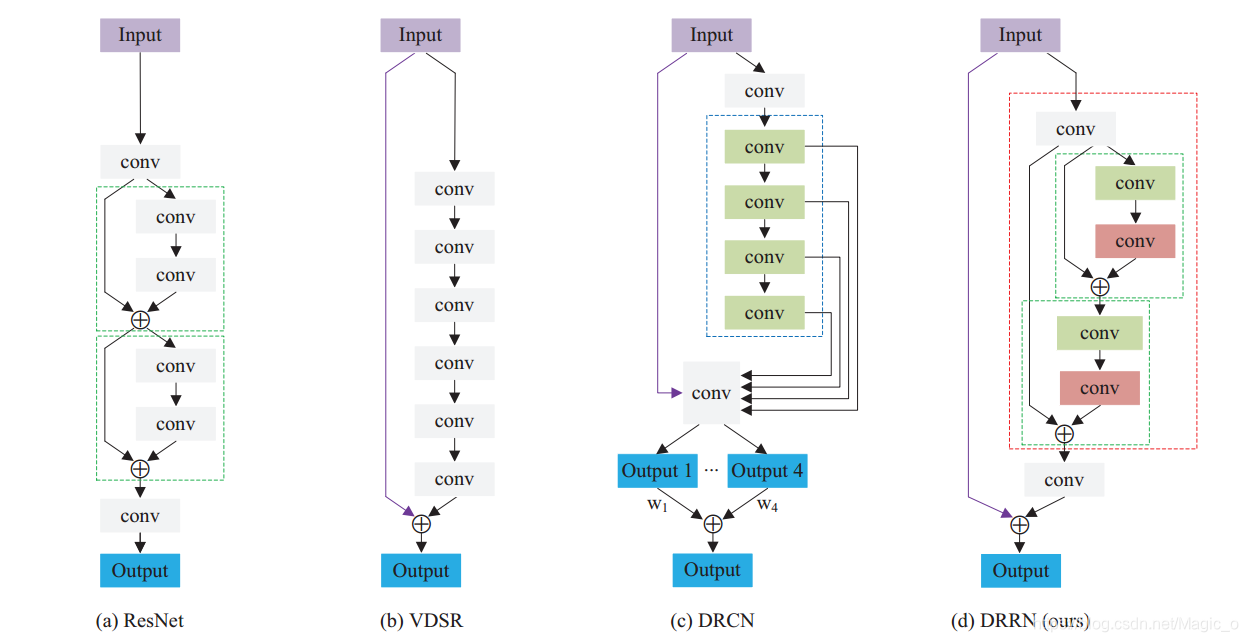

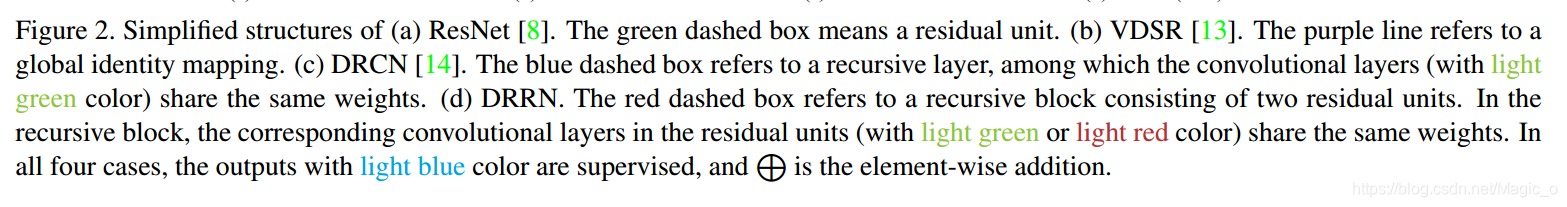

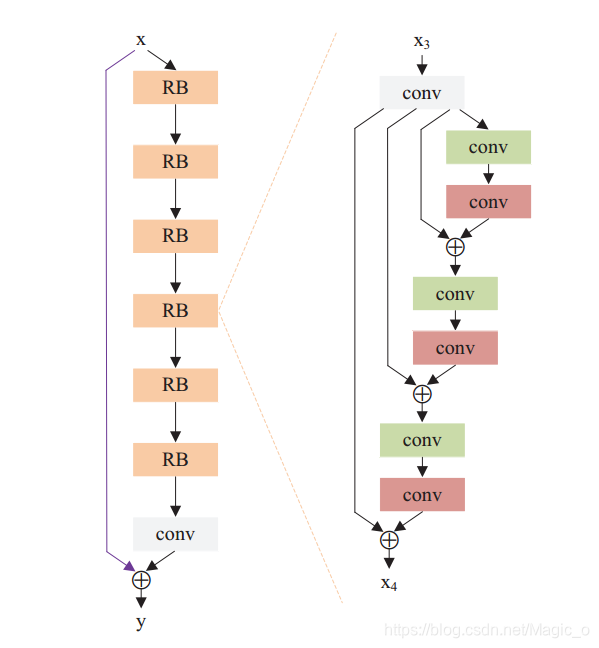

Both global and local residual learning。全局和局部残差学习。

用GRL,解决深度增加细节增加的问题,增强的剩余单元结构,称为作为多路径模式的本地残差学习(LRL),好处带来很多细节,同时改善梯度下降的。两个的区别是GRL是在输入层和输出层里。LRL是每几个堆叠的层中执行LRL

DRRN和DRCN的区别。

DRRN在残差中共享权重,DRCN在卷积层中共享权重。

2 related work

3. Deep Recursive Residual Network

由残差单元到递归块再到整个网络结构。

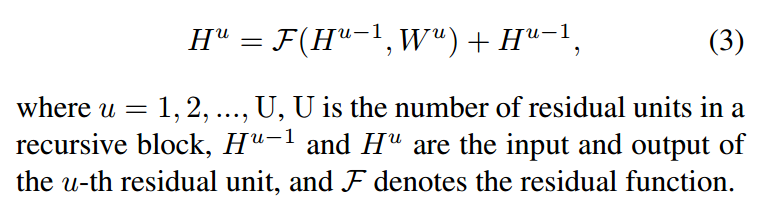

残差单元:pre-activation structure用前激活版本。

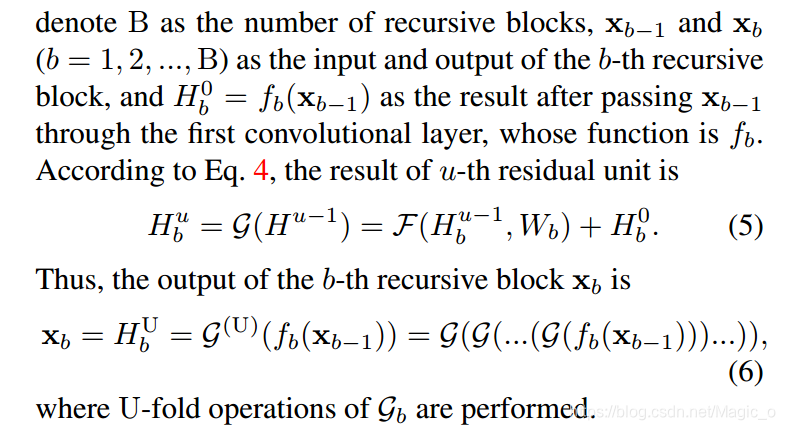

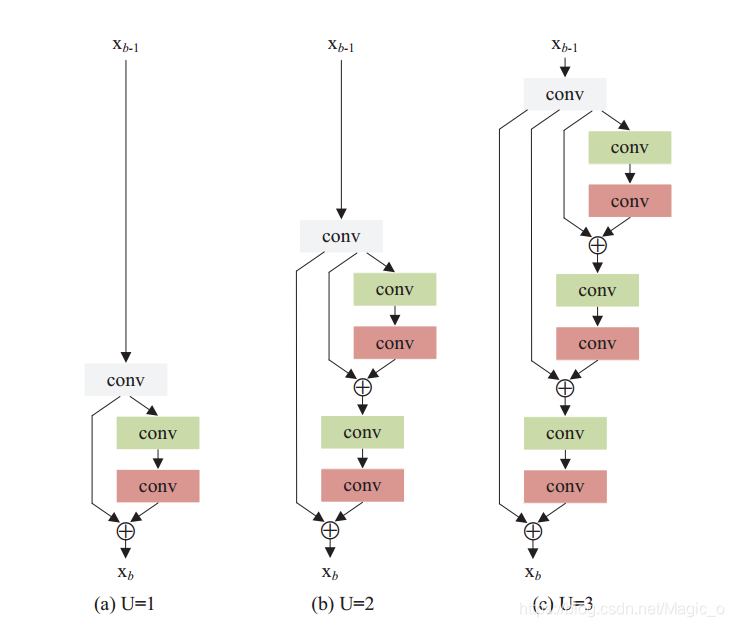

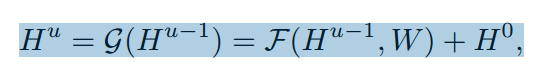

u是在递归层中的残差单元的个数。

G表示残差单位的函数,

H0是递归块中第一卷积层的结果。由于是递归学习残差单位,因此权重集

W在递归内的残差单元之间共享,但在不同的递归块中有所不同。

在递归块之前引入卷积层。