KNN算法

(机器学习实战)

K-近邻算法采用测量不同特征值之间的距离方法进行分类。

工作原理:

- 已有一个样本数据集,即训练集,并且训练集的每个数据都有其对应的分类标签。输入没有标签的新数据后,将新数据的每个特征与样本集中的数据对应的特征进行比较,然后算法提取样本集中特征最相似的数据的分类标签。也就是看最相近的k个数据的标签,通过多数表决的方式进行。

- 这里的k-NN的k即为选择的样本数据集中的前k个最相似的数据,通常k设置为不大于20的整数

通过距离度量来计算查询点(query point)与每个训练数据点的距离,然后选出与查询点(query point)相近的K个最邻点(K nearest neighbors),使用分类决策来选出对应的标签来作为该查询点的标签。

例子:

-

电影分类

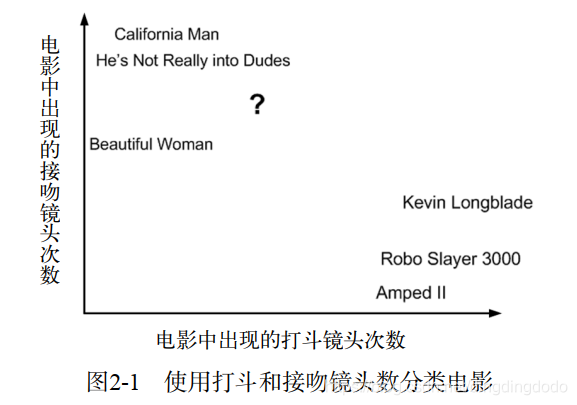

现在已知电影分类为动作电影和爱情电影,其中已有数据为每部电影的打斗镜头和接吻镜头的数量。如何通过已有数据对未知电影分类呢?

可以先对已有数据进行大致的绘图:

很显然我们猜测未知电影应该是属于爱情片的。实际上kNN算法的思想就是如此简单,通过查看离未知点最近的k个点的标签来推测该点的标签

用数学的方法表示:

可以定义一种距离,根据具体的情况定义即可。在此用普通的欧拉距离(当然我觉得可以给每种属性一个权重,但是如何定义权重应该用先验知识和已知数据去共同决定)

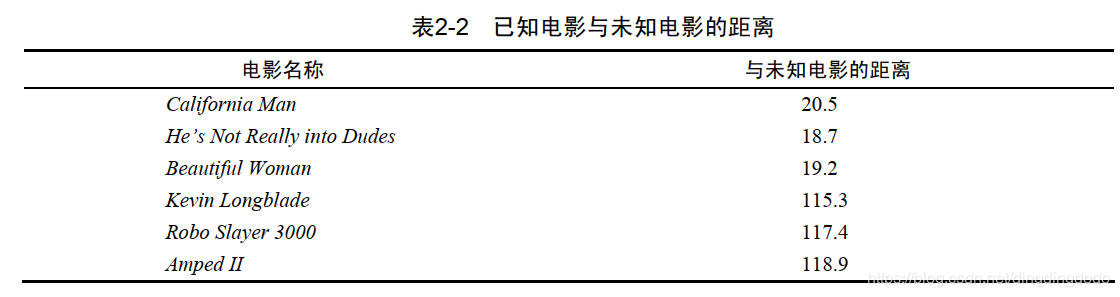

手动计算一下已知的6部电影与未知电影的距离:

故如果选择k=3,则只看前3项,由于前3项均为爱情电影,故我们可以推测未知电影为爱情电影。当然,如果 设置k=3且前3项中有一个动作电影,根据多票同意原则仍将该电影视为爱情电影。

操作:

- 读取已有数据,并对数据进行初步处理

- 对每个新加入的点,计算该点与之前数据集中所有点的距离

- 对距离排序并只取最小的前k个点

- 通过前k个点的类别确认出该范围内最高频的类别,将其视为该点的预测

实战:

通过约会数据进行分类

海伦一直使用在线约会网站寻找适合自己的约会对象。尽管约会网站会推荐不同的

人选,但她并不是喜欢每一个人。经过一番总结,她发现曾交往过三种类型的人:

- 不喜欢的人 didntLike

- 魅力一般的人 smallDoses

- 极具魅力的人 largeDoses

海伦收集约会数据已经有了一段时间,她把这些数据存放在文本文件datingTestSet.txt中,每

个样本数据占据一行,总共有1000行。海伦的样本主要包含以下3种特征

- 每年获得的飞行常客里程数

- 玩视频游戏所耗时间百分比

- 每周消费的冰淇淋公升数

采用KNN算法帮助海伦分类约会对象:

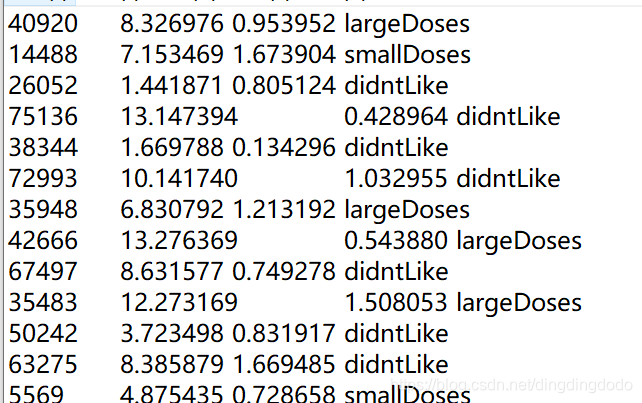

数据格式如图:

故读取数据:

import matplotlib

import matplotlib.pyplot as plt

import numpy as np

#用字典将str映射到int类型,即三种类型用3,2,1代表

dict = {'largeDoses': 3, 'smallDoses': 2, 'didntLike': 1}

def file2matrix(filename):

fr = open(filename)

# 获得文件中的数据行的行数

numberOfLines = len(fr.readlines())

# 生成对应的空矩阵

returnMat = np.zeros((numberOfLines, 3)) # prepare matrix to return

classLabelVector = [] # prepare labels return

fr = open(filename)

index = 0

for line in fr.readlines():

# str.strip([chars]) --返回已移除字符串头尾指定字符所生成的新字符串

line = line.strip()

# 以 '\t' 切割字符串

listFromLine = line.split('\t')

# 每列的属性数据

returnMat[index, :] = listFromLine[0:3]

# 每列的类别数据,就是 label 标签数据

classLabelVector.append(int(dict[(listFromLine[-1])]))

index += 1

# 返回数据矩阵returnMat和对应的类别classLabelVector

return returnMat, classLabelVector

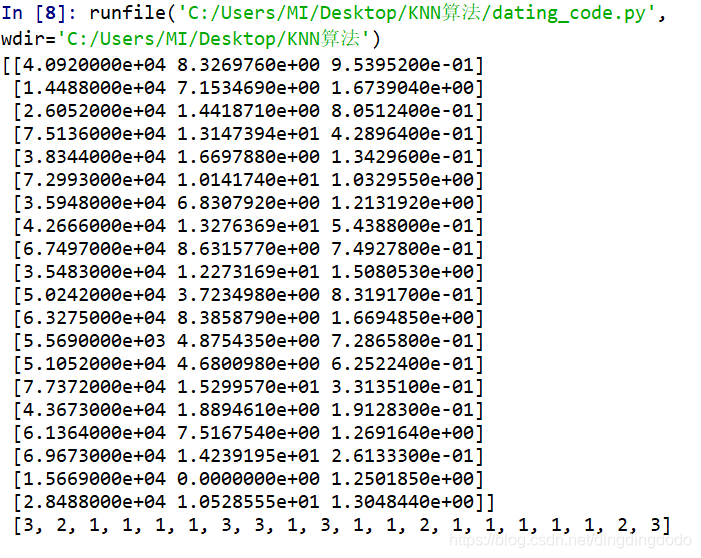

查看数据的前20项了解数据布局:

DatingDataMat,DatingLables=file2matrix('datingTestSet.txt')

print(DatingDataMat[0:20],'\n',DatingLables[0:20])

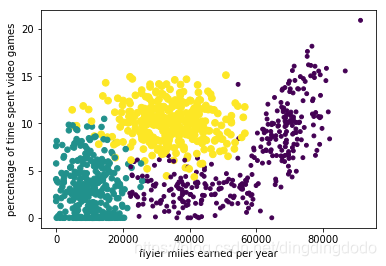

通过Matplotlib创建散点图大致看一下数据的类型分布(为了方便在此仅取前两个特征,即飞机里程数和玩视频游戏所耗时间占比):

fig = plt.figure()

ax = fig.add_subplot(111)

ax.scatter(DatingDataMat[:,0], DatingDataMat[:,1], 15.0*np.array(DatingLables), 15.0*np.array(DatingLables))

plt.xlabel("flyier miles earned per year")

plt.ylabel("percentage of time spent video games")

plt.show()

在此处我对三种特征两两选取进行了散点图描绘,取后两个特征的点的分类效果较差,故很可能说明第一个特征具有相对较强的影响权重。

对数据提取后,便可以开始建立kNN模型,如果我们用欧拉距离表示距离的话,存在一个问题,即三个因素的量级不同,飞行里程数字过大,将几乎完全主导距离,因此需要进行归一化数据处理

归一化数据处理:

归一化目的就是将不同尺度上的评判结果统一到一个尺度上,从而可以作比较,作计算

如果数据的不同属性对样本影响一致,则直接令三个数据均归一化,使范围设置在0-1,最简单的方法为:

newValue=(oldValue-min)/(max-min)

通过该方法很容易将每个属性值均设置在0-1间。当然该归一化方法在特殊数据集上可能有较差的效果,可以考虑别的归一化函数。

归一化函数的代码:

def autoNorm(dataSet):

"""

parameter:

dataSet: 数据集

return:

归一化后的数据集 normDataSet

归一化公式:

Y = (X-Xmin)/(Xmax-Xmin)

"""

# 计算每种属性的最大值、最小值、范围

minVals = dataSet.min(0)

maxVals = dataSet.max(0)

# 极差

ranges = maxVals - minVals

normDataSet = np.zeros(np.shape(dataSet))

m = dataSet.shape[0]

# 生成与最小值之差组成的矩阵

normDataSet = dataSet - np.tile(minVals, (m, 1))

# 将最小值之差除以范围组成矩阵

normDataSet = normDataSet / np.tile(ranges, (m, 1)) # element wise divide

return normDataSet

查看归一化后的结果:

因此可以进行距离计算以及排序和筛选前k项并输出其结果

核心代码:

def classify0(inX, dataSet, labels,k):

'''

intX为输入向量,在此处为[x,y,z]

dataSet为数据集

labels为数据集对应的标签集

k为取前多少邻近

'''

dataSetSize = dataSet.shape[0]

#距离度量 度量公式为欧氏距离

diffMat = np.tile(inX, (dataSetSize,1)) - dataSet

sqDiffMat = diffMat**2

sqDistances = sqDiffMat.sum(axis=1)

distances = sqDistances**0.5

#将距离排序:从小到大

sortedDistIndicies = distances.argsort()

#选取前K个最短距离, 选取这K个中最多的分类类别

classCount={}

for i in range(k):

voteIlabel = labels[sortedDistIndicies[i]]

classCount[voteIlabel] = classCount.get(voteIlabel,0) + 1

sortedClassCount = sorted(classCount.items(), key=operator.itemgetter(1), reverse=True)

return sortedClassCount[0][0]

此时输入intX将返回相应的结果。基于此函数对测试集进行测试,查看错误率如何:

def error_rate():

#读取测试数据集

testdata,test_real_lable=file3matrix('datingTestSet2.txt')

#对属性值归一化处理

testdata=autoNorm(testdata)

nums=len(testdata)

right_num=0

for i in range(nums):

if(classify0(testdata[i],a,DatingLables,10)==test_real_lable[i]):

right_num+=1

return 1-right_num/nums

当k=10时,错误率为0.037,故正确率是较高的。

调整k值可知,在合适范围内增大k值会使得正确率会上升。

手写数字识别系统

构造一个能识别数字 0 到 9 的基于 KNN 分类器的手写数字识别系统。

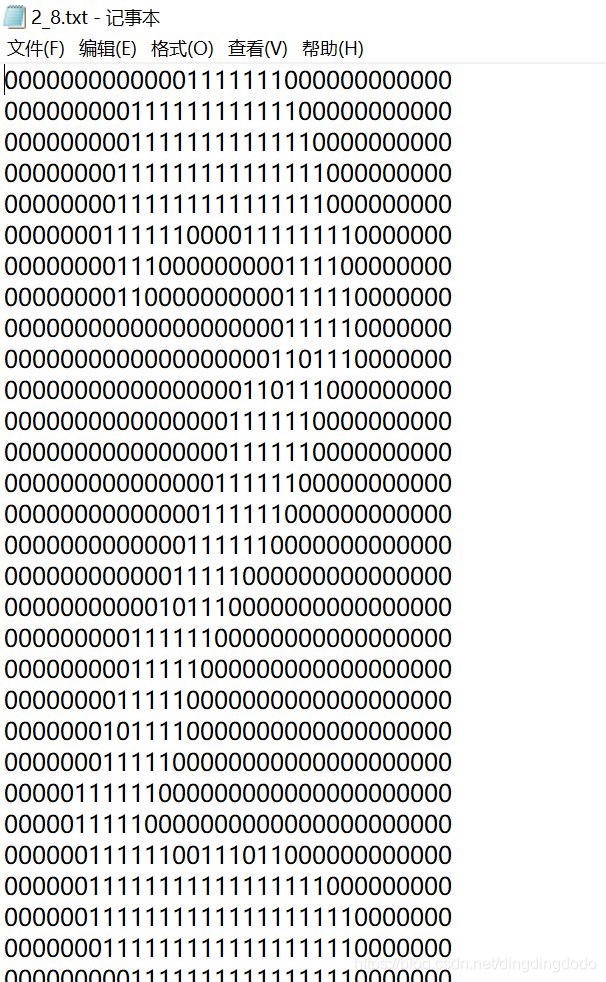

需要识别的数字是存储在文本文件中的具有相同的色彩和大小:宽高是 32 像素 * 32 像素的黑白图像

查看数据的组成:

故先考虑如何将图像的内容转变为可处理的向量:

def img2vector(filename):

returnVect = zeros((1,1024))

fr = open(filename)

for i in range(32):

lineStr = fr.readline()

for j in range(32):

returnVect[0,32*i+j] = int(lineStr[j])

return returnVect

利用os.listdir函数读取整个文件夹,然后设置相应的字符串分别读取每一个txt文件的内容,从而实现训练数据的向量化。

----

trainingFileList = listdir('trainingDigits') #load the training set

m = len(trainingFileList)

trainingMat = np.zeros((m,1024))

for i in range(m):

fileNameStr = trainingFileList[i]

fileStr = fileNameStr.split('.')[0] #take off .txt

classNumStr = int(fileStr.split('_')[0])

hwLabels.append(classNumStr)

trainingMat[i,:] = img2vector('trainingDigits/%s' % fileNameStr)

----

利用上一个实例相同的思路,对测试数据进行测试(距离函数、归一化函数均具有普适性,不需要更改):

实现测试:

testFileList = listdir('testDigits') #iterate through the test set

errorCount = 0.0

mTest = len(testFileList)

for i in range(mTest):

fileNameStr = testFileList[i]

fileStr = fileNameStr.split('.')[0] #take off .txt

classNumStr = int(fileStr.split('_')[0])

vectorUnderTest = img2vector('testDigits/%s' % fileNameStr)

classifierResult = classify0(vectorUnderTest, trainingMat, hwLabels, 3)

if (classifierResult != classNumStr):

errorCount += 1.0

print ("\nthe total number of errors is: %d" % errorCount)

print ("\nthe total error rate is: %f" % (errorCount/float(mTest)))

测试结果为错误率在0.01左右

总结

如果选择较小的 k 值,就相当于用较小的邻域中的训练实例进行预测,“学习”的近似误差(approximation error)会减小,只有与输入实例较近的(相似的)训练实例才会对预测结果起作用。但缺点是“学习”的估计误差(estimation error)会增大,预测结果会对近邻的实例点非常敏感。如果邻近的实例点恰巧是噪声,预测就会出错。换句话说,k 值的减小就意味着整体模型变得复杂,容易发生过拟合

如果选择较大的 k 值,就相当于用较大的邻域中的训练实例进行预测。其优点是可以减少学习的估计误差。但缺点是学习的近似误差会增大。这时与输入实例较远的(不相似的)训练实例也会对预测起作用,使预测发生错误。 k 值的增大就意味着整体的模型变得简单。