一、 总览:

二、 配置文件的修改:

1. core-site.xml的修改:

从hadoop的安装目录进入到 /etc/hadoop文件夹,可找到如下文件:

编辑core-site.xml将,在<configuration></configuration>中添加如下内容:

<!--指定HDFS中NameNode的地址-->

<property>

<name>fs.defaultFS</name>

<value>hdfs://nodeb1:9000</value>

</property>

<!--指定Hadoop运行时产生文件的存储路径-->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/hadoop-2.7.2/data/tmp</value>

</property>

其中第4行hdfs后填入的应为主机名:9000,主机名不可有 _ 之类的特殊字符

如需修改或查看主机名,可访问文件 /etc/hostname

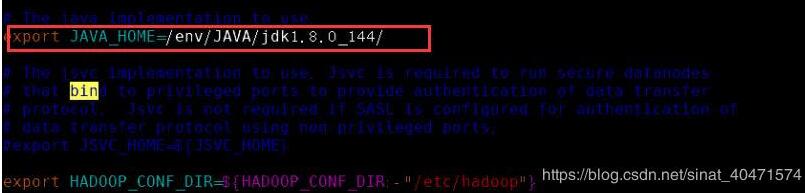

2. hadoop-env.sh的修改:

获取JAVA_HOME:

![]()

将得到的路径填入hadoop-env.sh中如图所示位置:

3. hdfs-site.xml的修改:

打开文件,在<configuration></configuration>中添加如下内容即可:

<!--指定HDFS副本数量-->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

三、 启动集群:

1. 格式化NameNode:

进入到hadoop安装目录下,输入命令:

bin/hdfs namenode -format

2. 启动NameNode:

sbin/hadoop-daemon.sh start namenode

完成后先跳到第4步查看集群启动情况,这时NameNode应已启动,如未启动参考第5步。

3. 启动DataNode:

sbin/hadoop-daemon.sh start datanode

4. 查看集群启动状况:

输入命令 jps 检查是否启动成功

5. 出错的解决办法:

进入Hadoop安装目录的 logs 文件夹下,查看对应节点的 log 文件报错信息,确定报错信息并修改后应先关闭NameNode和DataNode,再删除 logs 文件夹后重新进行初始化。