版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/pku_langzi/article/details/81174386

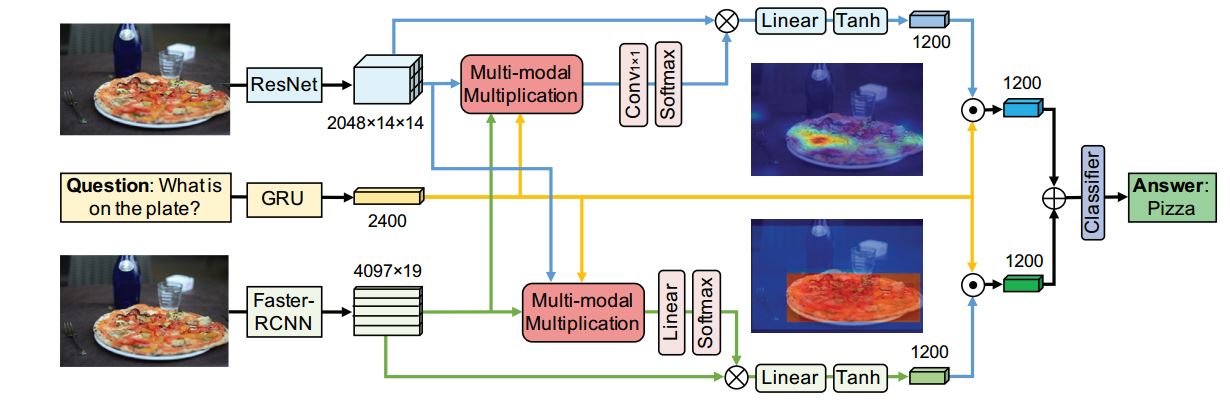

Co-Attending Free-Form Regions and Detections with Multi-Modal Multiplicative Feature Embedding for Visual Question Answering

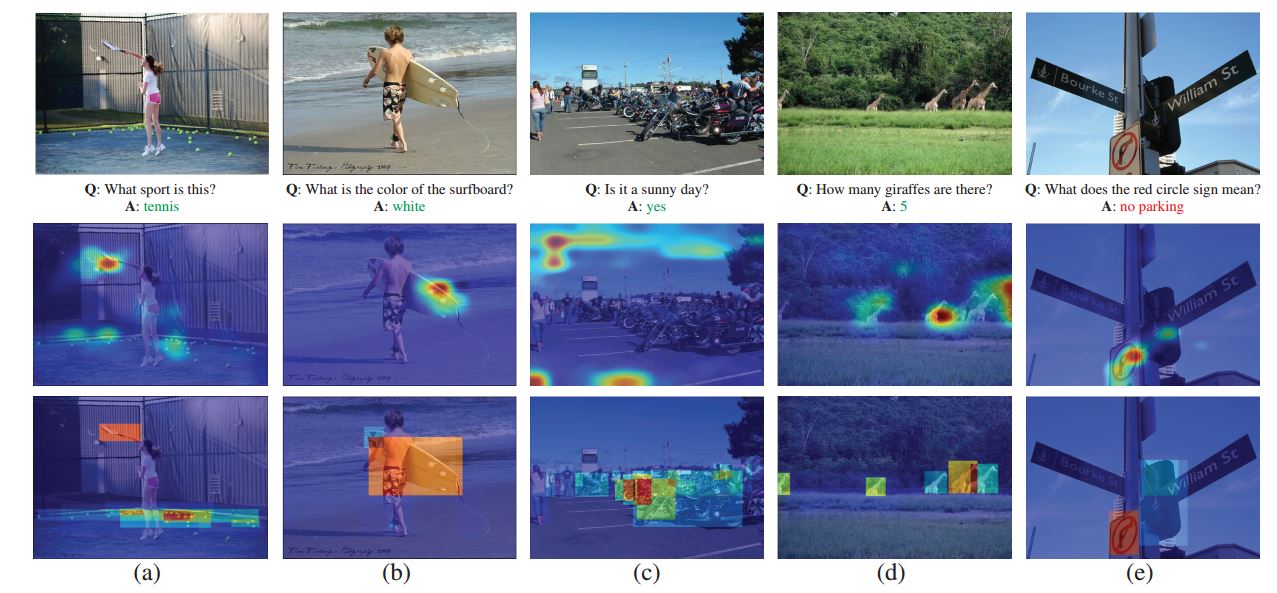

现在做VQA的,很多方法都是基于question在图像中寻找显著性区域,来获得相应answer。

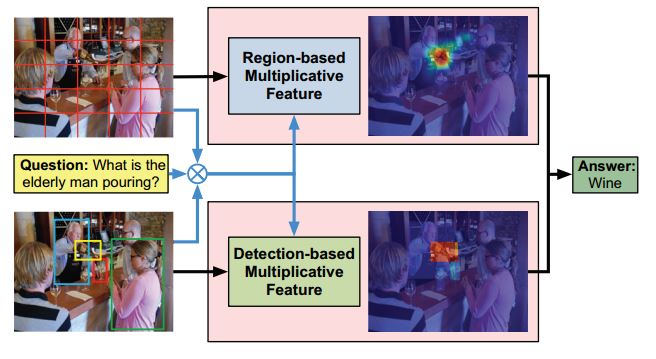

attention主要分为两支free-form region based 和 detection-based 。

两支单独做,各有弊端,比如free-form的图像的切分往往会把object分成很多细粒度块,而如cat的身体与狗的身体块,可

能很相似,这样会误导模型产生错误的答案,而dection based mechanism往往事先检测出实体区域,对于许多涉及前景的

问题很有利,但比如“How is the weather today?”这样的问题确比较难,因为或许不存在sky这样的bounding box。

因此本文将两种方式结合起来,彼此互补。

方法思想

网络结构

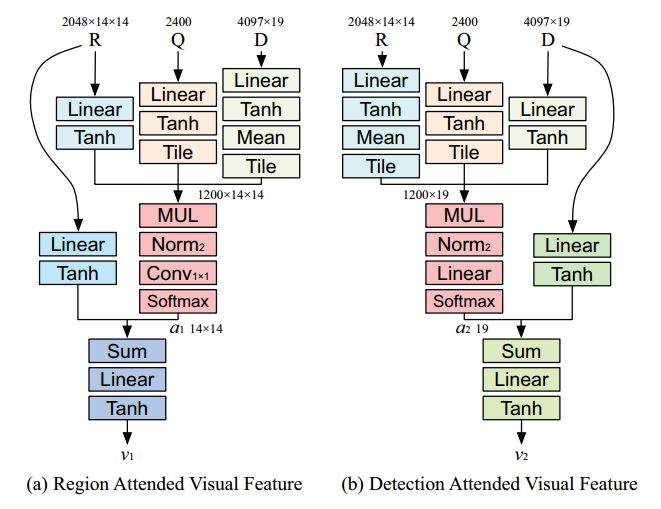

free based是利用Resnet152提取14*14*2048特征,可视为划分196个图像区域。

扫描二维码关注公众号,回复:

4454211 查看本文章

detection based是利用fasterrcnn提取19个bounding box特征19*4097(其中4096是图像特征,1是

bounding box的检测得分。)

attention细节

数据集

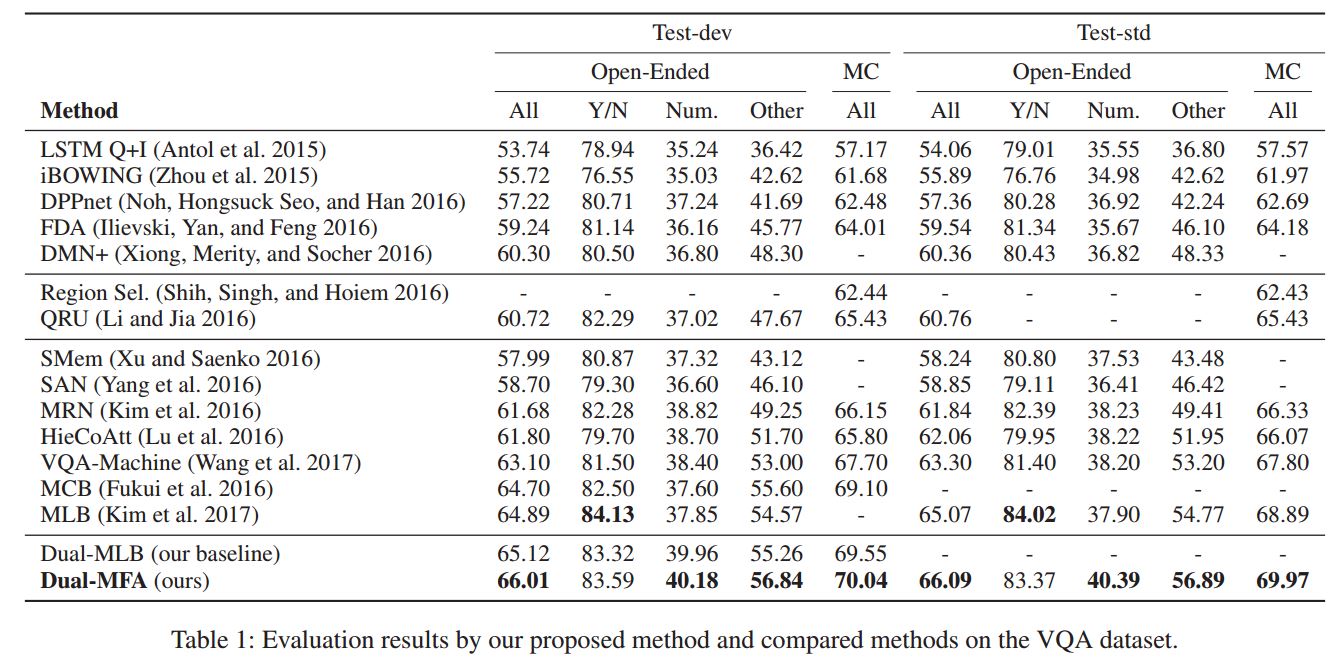

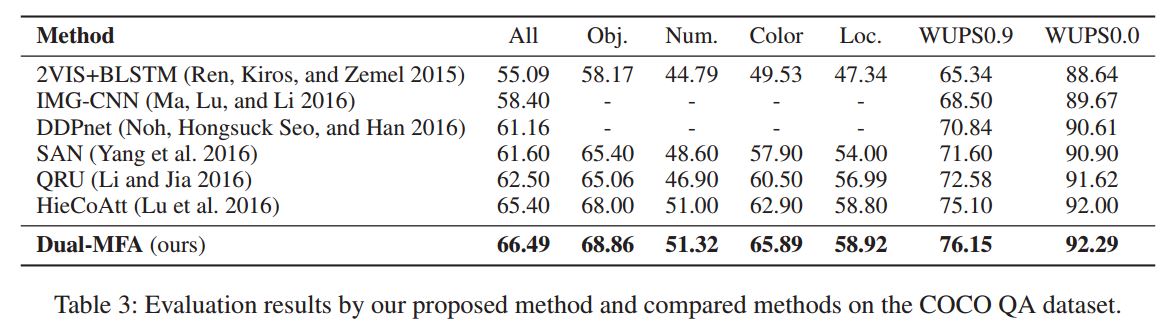

VQA, COCO-QA

结果

github源码:dual-mfa-vqa